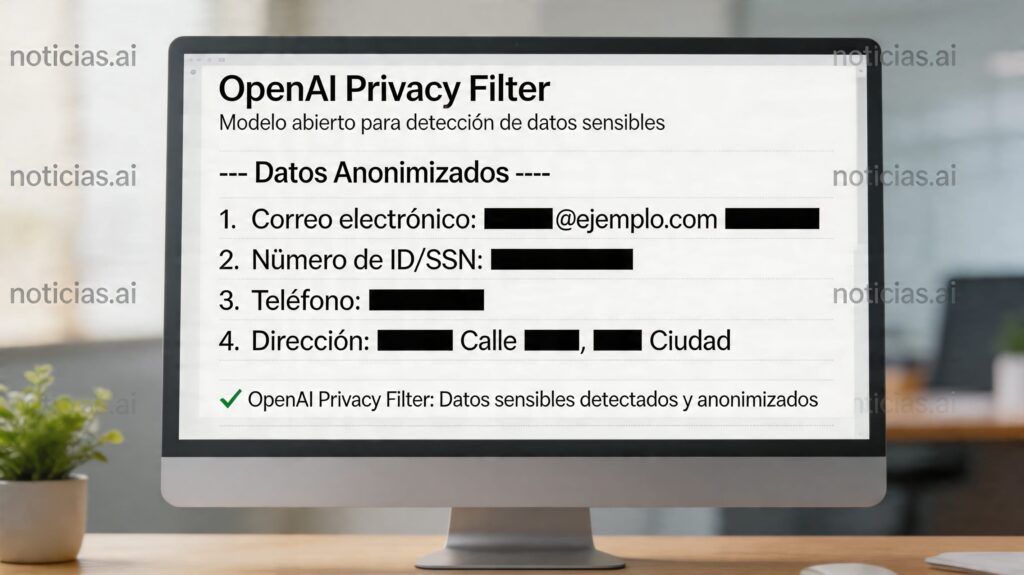

OpenAI ha lanzado Privacy Filter, un modelo abierto diseñado para detectar y enmascarar información personal identificable en texto antes de que acabe en registros, bases vectoriales, sistemas RAG, procesos de revisión o flujos de entrenamiento. La compañía lo presenta como una herramienta de alto rendimiento para ejecutar en local, sin sacar el dato sensible del equipo, y lo publica con licencia Apache 2.0 tanto en Hugging Face como en GitHub.

La novedad tiene especial interés para el ámbito de la ciberseguridad porque responde a un problema cada vez más visible en empresas que despliegan asistentes internos, copilotos, motores de búsqueda documental o pipelines de observabilidad: el riesgo de que nombres privados, correos, teléfonos, números de cuenta o secretos como contraseñas y claves API terminen indexados, registrados o reutilizados en sistemas donde no deberían estar. OpenAI plantea Privacy Filter como una capa previa de protección para reducir esa exposición desde el origen.

Un modelo pequeño, especializado y orientado a producción

A diferencia de un gran modelo generativo, Privacy Filter no está pensado para redactar respuestas ni para mantener conversaciones. Es un modelo bidireccional de clasificación de tokens con decodificación de spans, lo que le permite analizar un texto completo en una sola pasada y marcar qué fragmentos deben ocultarse. Según OpenAI, este enfoque mejora la velocidad y la eficiencia frente a estrategias basadas en generación token a token.

Su ficha técnica también llama la atención. OpenAI indica que el modelo tiene 1.500 millones de parámetros totales y 50 millones de parámetros activos, y que soporta hasta 128.000 tokens de contexto. En la práctica, eso significa que puede trabajar con documentos largos sin necesidad de trocearlos de forma agresiva y que, sobre el papel, puede ejecutarse incluso en un navegador o en un portátil. Para equipos de seguridad y cumplimiento, ese punto es importante: menos dependencia de servicios externos y más control sobre dónde se procesa la información antes de ser saneada.

OpenAI ha definido además una taxonomía concreta de ocho categorías de datos sensibles: private_person, private_address, private_email, private_phone, private_url, private_date, account_number y secret. Esta última categoría es especialmente relevante en entornos de seguridad porque incluye elementos como contraseñas y claves API, es decir, material que puede abrir la puerta a una intrusión o a una fuga de credenciales si acaba expuesto en texto plano.

Útil para RAG, logs y repositorios, pero no como única defensa

El valor de Privacy Filter no está solo en “tapar” texto, sino en funcionar como un filtro previo dentro de procesos más amplios. OpenAI lo sitúa expresamente en flujos de training, indexing, logging and review pipelines, lo que encaja con varios escenarios reales: bloquear la ingesta de documentos con PII antes de indexarlos en una base vectorial, limpiar logs antes de enviarlos a un SIEM, o revisar repositorios y fragmentos de código donde puedan haberse colado credenciales o secretos operativos.

En ese terreno, la especialización puede ser una ventaja. En vez de usar un LLM generalista, más caro y con más latencia, OpenAI propone un modelo pequeño, enfocado y ajustable a políticas concretas. Además, la compañía asegura haber incluido pruebas específicas sobre detección de secretos en bases de código y evaluaciones de estrés en casos multilingües, adversariales y dependientes del contexto, algo especialmente relevante para equipos de AppSec, DevSecOps y gobierno del dato.

En rendimiento, OpenAI afirma que Privacy Filter alcanza un 96 % de F1 en el benchmark PII-Masking-300k, con 94,04 % de precisión y 98,04 % de recall. También sostiene que, al corregir problemas de anotación detectados en ese conjunto de datos, la puntuación sube a 97,43 % de F1. Son cifras sólidas sobre el papel y apuntan a un modelo serio para producción, aunque conviene recordar que proceden de la propia evaluación del fabricante y que el comportamiento real siempre dependerá del dominio, del idioma y del tipo de texto que se quiera proteger.

La advertencia clave: no es anonimización completa ni cumplimiento automático

La parte más importante del anuncio quizá no esté en sus métricas, sino en sus límites. OpenAI advierte de forma explícita que Privacy Filter no es una herramienta de anonimización, no es una certificación de cumplimiento normativo y no es una garantía de seguridad por sí sola. La compañía recomienda usarlo como una pieza más dentro de una estrategia de privacy by design, no como una solución total que permita asumir que el riesgo ha desaparecido.

Esa advertencia es especialmente relevante para el sector de la seguridad. Eliminar un nombre, un correo o un número de teléfono no siempre evita la reidentificación si el contexto mantiene suficientes pistas alrededor. Del mismo modo, detectar secretos no equivale a resolver por completo la gestión de credenciales ni sustituye políticas de clasificación, retención, minimización o revisión humana. OpenAI reconoce también que el modelo solo detectará lo que encaje en su taxonomía entrenada y que distintas organizaciones pueden necesitar políticas distintas o ajustes finos adicionales.

También conviene rebajar otra expectativa que se ha repetido desde su publicación: Privacy Filter no se presenta oficialmente como un modelo “nativo en español”. La documentación de Hugging Face indica que está orientado principalmente al inglés, aunque incorpora cierta evaluación de robustez multilingüe. OpenAI, de hecho, avisa de que el rendimiento puede bajar en textos no ingleses, en escrituras no latinas o en dominios alejados de su distribución de entrenamiento. Puede servir en español, sí, pero no conviene dar por hecho que mantendrá el mismo nivel de precisión sin validación previa en entorno real.

En el fondo, el lanzamiento encaja con una tendencia cada vez más clara en seguridad aplicada a IA: modelos más pequeños, auditables y ejecutables en local para tareas críticas muy concretas. No sustituyen a los controles clásicos, pero sí pueden convertirse en una capa útil entre el dato bruto y los sistemas donde una fuga duele de verdad. En ese sentido, Privacy Filter no resuelve por sí solo la privacidad ni el cumplimiento, pero sí apunta a una dirección razonable: poner más controles especializados justo donde empieza el riesgo.

Preguntas frecuentes

¿Qué es OpenAI Privacy Filter y para qué sirve en seguridad?

Es un modelo abierto de clasificación de tokens diseñado para detectar y enmascarar datos personales identificables y secretos en texto antes de que entren en sistemas de indexación, logging, revisión o entrenamiento.

¿Puede ejecutarse sin enviar los datos a la nube?

Sí. OpenAI lo presenta como un modelo que puede funcionar en local, incluso en un navegador o en un portátil, para que el texto sensible no tenga que salir del dispositivo antes de ser filtrado.

¿Qué tipos de información sensible detecta?

Detecta ocho categorías: persona privada, dirección privada, correo privado, teléfono privado, URL privada, fecha privada, número de cuenta y secretos como contraseñas o claves API.

¿Sirve como anonimización completa o garantía de cumplimiento?

No. OpenAI advierte que no es una herramienta de anonimización total ni una certificación de cumplimiento, y recomienda usarlo como una capa adicional dentro de una estrategia más amplia de privacidad y seguridad.