La automatización con inteligencia artificial ha llegado también al pentesting. El repositorio pentest-ai-agents, publicado en GitHub por 0xSteph, reúne una colección de subagentes para Claude Code orientados a pruebas de penetración autorizadas, análisis defensivo, documentación técnica y generación de informes. Su propuesta es clara: convertir el entorno de Claude Code en un asistente especializado para equipos de seguridad que trabajan con reconocimiento, Active Directory, cloud, aplicaciones web, análisis forense, ingeniería inversa, detección y reporting.

La herramienta no es un producto comercial cerrado ni un servicio en la nube. Son agentes definidos en archivos de configuración y prompts especializados que se integran con Claude Code. El usuario instala esos agentes, abre Claude Code, describe una tarea y el sistema intenta enrutar la petición al especialista adecuado. El proyecto se presenta bajo licencia MIT y está pensado para contextos de seguridad con autorización previa, alcance definido y reglas de compromiso documentadas.

De un asistente genérico a un equipo de subagentes

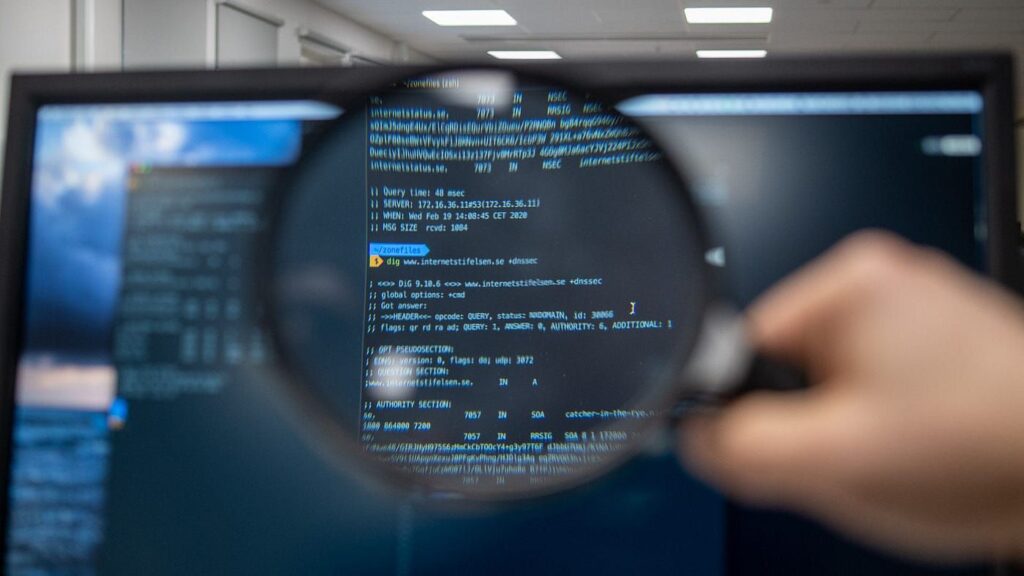

Claude Code es la herramienta agéntica de Anthropic para desarrollo: puede leer una base de código, editar archivos, ejecutar comandos e integrarse con flujos de trabajo de programación desde terminal, IDE, escritorio o navegador. Esa capacidad lo convierte en una base natural para crear agentes especializados, pero también exige controles claros cuando se usa en tareas sensibles.

Pentest-ai-agents aprovecha esa lógica y la aplica al ciclo de vida de una prueba de penetración. En lugar de usar un único prompt largo para todo, el proyecto divide el trabajo en subagentes con conocimiento de dominio. Hay agentes para planificación de engagement, reconocimiento, OSINT, análisis web, API, Active Directory, credenciales, cloud, mobile, wireless, ingeniería inversa, análisis de malware, forense, modelado de amenazas, cumplimiento STIG, generación de informes y detección defensiva.

La versión descrita en el repositorio habla de 31 subagentes, aunque algunas páginas indexadas todavía reflejan cifras anteriores de 28 agentes, algo habitual en proyectos que evolucionan rápido. La actualización v3.1 añade perfiles como payload-crafter, reverse-engineer y phishing-operator, además de comandos internos para recomendar agentes según la tarea y herramientas para auditar qué utilidades externas están instaladas en la máquina del analista.

El valor del enfoque no está solo en que la IA “sepa de pentesting”. La diferencia está en estructurar el trabajo por fases y especialidades. Un pentest real no consiste en lanzar herramientas sin criterio: empieza con alcance, reglas de compromiso, reconocimiento, priorización de superficie, validación, explotación controlada si procede, análisis de impacto, evidencias, recomendaciones y reporte. Dividir esa cadena en agentes puede ayudar a mantener más orden y reducir el trabajo repetitivo.

Utilidad para red team, blue team y consultoras

El repositorio se presenta como una ayuda para seguridad ofensiva autorizada, pero su utilidad no se limita al red team. Los agentes defensivos pueden generar reglas Sigma, consultas para Splunk, Elastic o Sentinel, árboles de ataque, análisis STRIDE o documentación de cumplimiento. También hay perfiles para análisis forense, extracción de indicadores de compromiso, revisión de STIGs y generación de informes ejecutivos.

Este punto es importante porque el pentesting moderno rara vez termina en una lista de vulnerabilidades. Las organizaciones necesitan entender rutas de ataque, priorizar correcciones, traducir hallazgos técnicos a riesgo de negocio y construir detecciones para que el SOC pueda observar comportamientos parecidos en el futuro. Un asistente bien usado puede ayudar a convertir hallazgos dispersos en documentación más consistente.

Para consultoras pequeñas o equipos internos con mucha carga, el atractivo es evidente. Un agente puede ayudar a preparar planes, ordenar resultados, redactar borradores de informes, transformar evidencias en hallazgos, proponer detecciones o revisar si una recomendación está alineada con marcos como MITRE ATT&CK, OWASP o NIST. No sustituye la experiencia del pentester, pero puede reducir horas de trabajo administrativo y aportar una segunda lectura técnica.

La función de base de datos de hallazgos también apunta en esa dirección. El proyecto incluye almacenamiento persistente en SQLite para mantener datos de un engagement entre sesiones, generar estadísticas y exportar resultados. En trabajos largos, esa persistencia puede ser útil para evitar que el contexto se pierda entre conversaciones o cambios de jornada.

La parte delicada: agentes ofensivos con herramientas reales

El lado sensible del proyecto está en su capacidad para trabajar con herramientas de seguridad ofensiva. La documentación menciona integraciones o soporte para utilidades habituales en reconocimiento, escaneo, análisis web, Active Directory, cloud, cracking, ingeniería inversa, forense y campañas de simulación social. En modo asesor, el usuario pega resultados y recibe análisis. En ciertos agentes de nivel 2, el sistema puede componer y ejecutar comandos con aprobación previa del usuario.

Esa frontera exige prudencia. En un laboratorio propio o en una prueba contratada, esa automatización puede mejorar la productividad. Fuera de un alcance autorizado, las mismas capacidades pueden convertirse en abuso. Por eso el propio repositorio insiste en que el uso debe limitarse a pruebas con autorización escrita y alcance definido. El problema de fondo es común a muchas herramientas de ciberseguridad: sirven para defender mejor, pero también pueden reducir la barrera de entrada a comportamientos indebidos.

El diseño con aprobación antes de ejecutar comandos es una salvaguarda razonable, pero no suficiente por sí sola. En entornos profesionales, una herramienta así debería usarse con cuentas separadas, máquinas de laboratorio, redes autorizadas, registros de actividad, control de secretos y revisión humana de cada acción que pueda afectar a terceros. También conviene evitar ejecutarla desde estaciones con acceso amplio a credenciales corporativas o repositorios sensibles.

Anthropic ha trabajado precisamente en esa tensión dentro de Claude Code. Su modo por defecto pide aprobación antes de ejecutar comandos o modificar archivos, y el modo automático experimental incorpora salvaguardas adicionales, aunque la propia compañía recomienda usarlo con cuidado y en entornos seguros o aislados.

Lo que dice de la nueva seguridad con IA

Pentest-ai-agents refleja una tendencia más amplia: la seguridad se está moviendo de herramientas aisladas hacia flujos agénticos. Antes un analista lanzaba una herramienta, copiaba la salida, la interpretaba, decidía el siguiente paso y escribía el informe. Ahora empiezan a aparecer sistemas que ayudan a encadenar esas fases, recordar contexto, priorizar tareas y producir entregables.

Eso puede elevar el nivel de muchos equipos, pero también introduce riesgos nuevos. Un agente puede malinterpretar un alcance, proponer una prueba demasiado agresiva, dar por válida una salida errónea o generar un informe con confianza excesiva. La velocidad no elimina la necesidad de criterio. La amplifica.

Para administradores de sistemas, responsables de seguridad y equipos DevSecOps, el enfoque más sensato es tratar estos agentes como copilotos técnicos. Pueden ayudar a analizar resultados, ordenar evidencias, sugerir pruebas no destructivas, preparar detecciones y documentar remediaciones. No deberían tener libertad para operar sin supervisión sobre redes reales, sistemas de terceros o entornos productivos.

La aparición de proyectos como pentest-ai-agents también anticipa un cambio en la formación. Los futuros pentesters no solo tendrán que saber usar herramientas, sino dirigir agentes, evaluar sus respuestas, detectar alucinaciones técnicas, validar hallazgos y mantener trazabilidad. La habilidad diferencial no será pedirle a una IA que “haga un pentest”, sino saber convertir una investigación autorizada en un proceso controlado, verificable y útil para el cliente.

La herramienta de 0xSteph no inventa el pentesting con IA, pero sí empaqueta una forma concreta de trabajarlo dentro de Claude Code. Su interés está en la modularidad, en la amplitud de dominios cubiertos y en la combinación de análisis ofensivo, defensa y reporting. Su límite está en el mismo punto que cualquier automatización potente: sin autorización, control y revisión humana, la productividad se convierte en riesgo.

Preguntas frecuentes

¿Qué es pentest-ai-agents?

Es un repositorio open source con subagentes para Claude Code orientados a pruebas de penetración autorizadas, análisis de seguridad, detección, forense y reporting.

¿Funciona como una plataforma SaaS?

No. El proyecto consiste en archivos de agentes y comandos que se instalan en Claude Code. No requiere servidores propios del proyecto ni una plataforma externa adicional, más allá del uso de Claude Code.

¿Puede ejecutar herramientas ofensivas automáticamente?

Algunos agentes contemplan un modo de ejecución con aprobación previa, pero el proyecto insiste en que solo debe usarse en entornos autorizados y con reglas de compromiso claras.

¿Para quién puede ser útil?

Para equipos de red team, consultoras de pentesting, analistas defensivos, responsables DevSecOps y equipos que quieran ordenar hallazgos, generar detecciones o acelerar informes sin perder supervisión humana.